サイバー空間でますます深く生きる

私たちが長年知っているサイバースペースと、仮想現実技術の発展などのおかげで出現したばかりの新しいサイバースペースとの違いは非常に大きいです。 これまで、私たちはデジタルの連続体を活用したくて、多かれ少なかれデジタルの連続体にアクセスするだけでした。 間もなく、私たちは完全にその世界に没頭することになるでしょう、そしてもしかしたら、サイバー世界から「現実世界」への周期的な移行さえ起こるかもしれません...

未来学者のレイ・カーツワイルによれば、私たちは一般的に20年代前半に生きています。 仮想環境で仕事や遊びをする, ビジュアルタイプは「フルイマージョン」。 30 年代には、触覚や味覚を含むすべての感覚を刺激する没入型の体験になるでしょう。

コーヒーを Facebook に持っていく

Facebook は、私たちの生活のすべてをデジタル世界に吸い込むことを目標に、素晴らしいインフラを構築しています。 この取り組みの一例として、Parse プラットフォームが挙げられています。 2015 年 8 月に F1 カンファレンスが開催され、その中で Facebook は XNUMX 年前に買収した同社の計画を発表しました (XNUMX)。 これは、モノのインターネット (IoT) 分野のデバイス、つまりネットワークに接続されて相互に通信するガジェットに一連の開発ツールを提供することで構成されています。

このプラットフォームは、スマート ホーム デバイスをウェアラブルやその周囲のあらゆるものに接続するように設計されています。

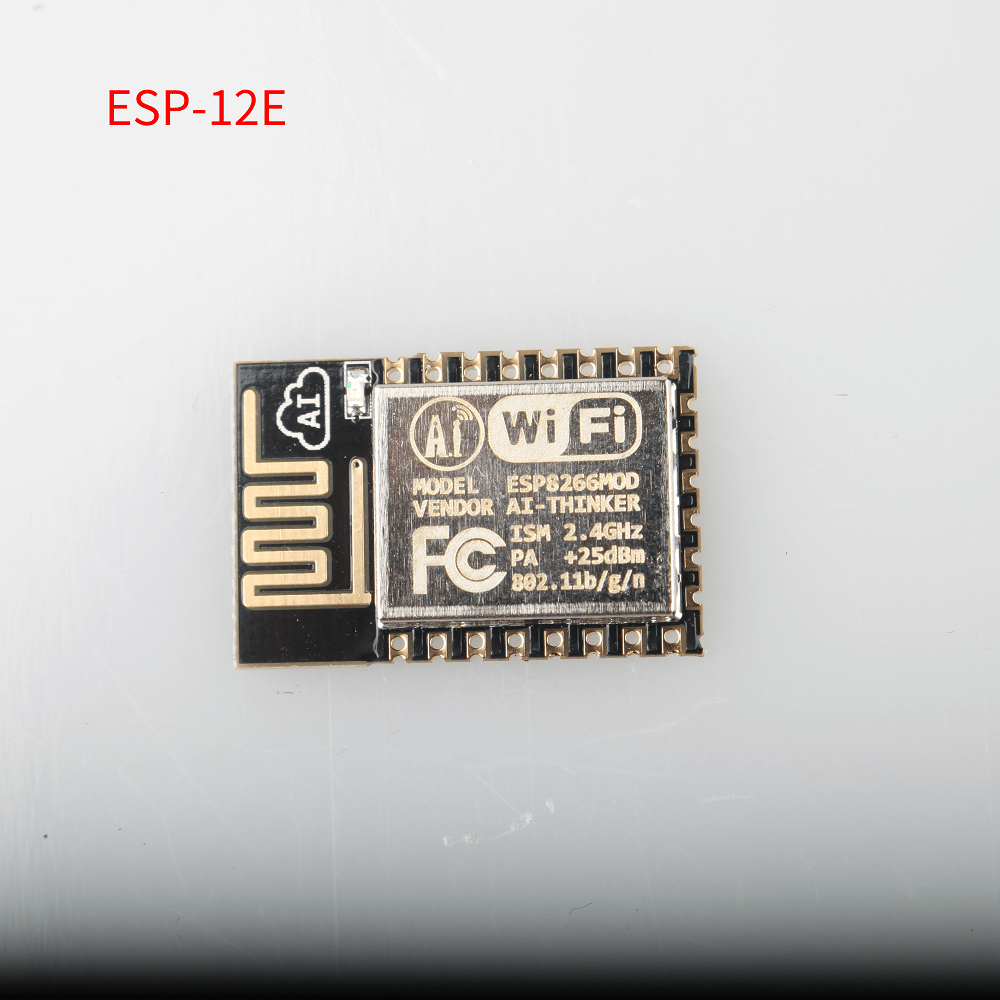

このツールのおかげで、たとえば、モバイル アプリケーションで制御されるスマートな植物灌漑システムや、写真を毎分記録するサーモスタットやセキュリティ カメラをすべて Web アプリケーションで制御する設計が可能になります。 Facebook は、Arduino Yun、Linux (Raspberry Pi 上)、リアルタイム オペレーティング システム (RTOS) の XNUMX つのプラットフォームで IoT 用の Parse SDK をリリースする予定です。

これは実際には何を意味するのでしょうか? 実際のところ、数行のコードを入力するだけの簡単な方法で、環境内の単純なデバイスを要素にすることができます。 デジタルリアリティ モノのインターネットに接続します。 Parse はさまざまな視覚デバイス、カメラ、レーダーの制御にも使用できるため、作成 (VR) の方法でもあり、遠隔地や到達困難な場所を仮想的に探索できます。

2.Magic Leapで作成したイメージ

多くの専門家によると、Oculus Riftを含む他のプラットフォームも同じ方向に発展するとのことです。 コネクテッドグラスは、ゲームや映画の世界に限定されるのではなく、私たちの周囲の世界を仮想現実にもたらすことができます。 これは、ゲームのクリエイターによる単なるゲームではありません。 ユーザーが選んだ環境でプレイできるゲームとなります。 ここで話しているのは拡張現実 (AR) のことではなく、たとえ Microsoft の HoloLens や Google の Magic Leap (2) ほど洗練されたものであってもです。 それは拡張現実ではなく、現実の風味を加えた仮想現実になります。 これは、Facebook から本物のコーヒーを取り出して飲むことができる世界です。

Facebookは、仮想現実を使用するアプリケーションに取り組んでいることを認めており、Oculusの買収はより大きな計画の一部である。 同プラットフォームのプロダクトマネージャーであるクリス・コックス氏は、コード/メディアカンファレンスで同社の計画について語った。 同氏によると、写真やビデオなどのマルチメディア リソースを共有できるようになり、人気のソーシャル ネットワークのサービスに仮想現実が追加される予定です。 コックス氏は、VR はサービスのユーザー エクスペリエンスの開発の論理的な継続であり、「思考、写真、ビデオを提供でき、VR を使用するとより完全な画像を送信できる」と説明しました。

既知の仮想性と未知の仮想性

80 年代初頭、ウィリアム ギブソン (3) が小説『ニューロマンサー』の中でこの言葉を初めて使用しました。 サイバースペース。 彼はそれを集団的な幻覚であり、ある種のインターフェースであると説明しました。 コンピューターオペレーターはニューラルリンクを介してそれに接続されていました。 これにより、コンピュータが生成した人工空間に転送し、コンピュータに含まれるデータを視覚的に表現することができました。

先見の明のある人々が仮想現実をどのように想像したかを少し見てみましょう。 人工的に作られた現実に入る方法は XNUMX つに集約できます。 それらの最初のものは、これまでのところファンタジー文学(たとえば、上記のニューロマンサー)でのみ見られるものであり、世界への完全な没入を意味します。 サイバースペース。 これは通常、脳への直接刺激によって達成されます。 そうして初めて、人から現実の環境から発せられる刺激を奪いながら、人にあらゆる刺激を与えることが可能になるのです。

これだけで仮想現実に完全に浸ることができます。 そのような解決策はまだありませんが、その取り組みは続けられています。 ブレイン インターフェイスは現在、最もダイナミックな研究分野の XNUMX つです。

VR に移行する XNUMX 番目の方法は、かなり不完全ではありますが、急速に発展している形で、現在利用可能です。 生身の身体を通じて適切な刺激を提供します。 ヘルメットやメガネに隠されたXNUMXつのスクリーンを通して目に映像が送られる。

物体の抵抗は、手袋またはスーツ全体に隠された適切なデバイスを使用してシミュレートできます。 このソリューションでは、人工的に作成されたインセンティブが、現実世界によって提供されるインセンティブを何らかの形で覆い隠します。 しかし、私たちは、私たちが見たり、触れたり、匂いを嗅いだり、味わったりするものはコンピューターの錯覚であることを常に認識しています。 したがって、たとえばゲームでは、現実よりもはるかに進んでリスクを負います。

最後の、そして最も表面的な侵入方法 サイバースペース これは実際に今日の日常生活です。

これには、Google、Facebook、Instagram、Twitter、およびインターネットのサイバースペースの隅々が含まれます。 また、コンピューターやコンソールでプレイするあらゆる種類のゲームも含まれます。 多くの場合、私たちはこれに夢中になってしまいますが、それでも、刺激は通常、画像と音で終わります。 私たちはゲームの世界に「囲まれて」いませんし、現実を模倣した動きをしません。 触覚、味覚、嗅覚を刺激しません。

しかし、ネットワークは人間にとって新しい自然環境であることが判明しました。 彼が参加してその一員になりたいと思える環境。 カーツワイルのようなトランスヒューマニストの夢は、たとえばXNUMX年前に考えられていた完全な空想とはもはや思えない。 人は生活のほぼすべての側面でテクノロジーに浸り、生活しており、時にはネットワークへの接続が 24 日 XNUMX 時間つきまといます。 ベルギーの思想家アンリ・ヴァン・リールのビジョン、vol. 弁証法的機械の世界ますます高密度化する通信ネットワークが私たちの目の前で実現されつつあります。 この道のステップの XNUMX つは、既存のグローバル コンピュータ ネットワーク、つまりインターネットです。

興味深いのは、人間文化の無形の部分全体がますます仮想化され、物理的な現実から切り離されていることです。 一例はメディアであり、そのメッセージは物理的な基盤から切り離されています。 コンテンツは重要であり、紙、ラジオ、テレビなどのメディアは、物理的に必要ではないチャネルのみが可能になります。

自分の気持ちをすべて受け入れて

ビデオ ゲームは、最先端の VR 機器がなくても中毒性があります。 ただし、すぐにプレイヤーは仮想ゲームプレイの世界にさらに深く飛び込むことができるようになります。 すべては Oculus Rift などのデバイスのおかげです。 次のステップは、私たちの自然な動きを仮想世界にもたらすデバイスです。 そのような解決策が目前にあることが判明しました。 すべては、私たちの足の動きを仮想世界に伝えるコントローラー、WizDish のおかげです。 キャラクターは、私たちが特別な靴を履いて WizDish (4) に沿って移動するときにのみ移動します。

Microsoft が最初に Minecraft を 2,5 億で買収し、その後 HoloLens メガネを寄付したのは偶然ではないようです。 このゲームに精通していて、レドモンドの AR ゴーグルがどのように機能するかを知っている人は、そのような組み合わせの素晴らしい可能性をすぐに理解するでしょう (5)。 これは現実と Minecraft の世界です。 現実の要素を備えた Minecraft ゲーム。 「Minecraft」と他のゲーム、そして現実の友達。 可能性はほぼ無限です。

これに追加のインセンティブを追加します。 仮想世界 さらに現実に近い。 英国ブリストル大学の科学者らは、立体的に投影された物体の形状を指の下で感じやすくする「エアタッチ」技術を開発した。

借りている 仮想オブジェクト すべて超音波の焦点のおかげで、それらが存在し、指先の下にあるという印象を与えるはずです (6)。 このテクノロジーの説明は、専門誌「ACM Transactions on Graphics」に掲載されました。 これは、3D で表示されるオブジェクトの周囲の触覚が、投影システムに搭載された数千の小型スピーカーによって生成されることを示しています。 このシステムは手の位置を検出し、物体の表面の感覚として感じられる適切な超音波パルスで応答します。 このテクノロジーにより、デバイスとの物理的接触の必要性が完全に排除されます。 その作成者は、仮想オブジェクトの形状と位置の変化を感知する機能の導入にも取り組んでいます。

「仮想タッチ」の既知の技術やプロトタイプは、通常、指の下で感じられる振動やその他の単純な信号の生成に還元されます。 しかし、Dexmo セット (7) は、それ以上の、表面に触れることに対する抵抗感を与えると説明されています。 したがって、ユーザーは実際のオブジェクトの感触を「実際に」感じなければなりません。 外骨格には適切なタイミングで指を止める複雑なブレーキ システムが組み込まれているため、指への抵抗は本物です。 その結果、ソフトウェアとブレーキのおかげで、各指はボールなどの現実のオブジェクトの表面で停止したかのように、仮想オブジェクト内のわずかに異なる点で停止します。

5. HoloLens と仮想世界

7. Dexmo グローブのさまざまなオプション

次に、ライス大学の学生グループは最近、仮想現実、つまり空中の物体に「触れ」たり「捕まえたり」できる手袋を開発しました。 ハンズ オムニ グローブ (8) を使用すると、オブジェクトの仮想世界に「触れる」ことで、形状やサイズを体験できます。

フィードバックのおかげで コンピューターワールドそれは、適切な装備を身に着けた人が見ると、手袋によって生み出される感覚によって、現実と同等の感触を生み出す必要があります。 物理的な意味では、これらの感覚はハンズ オムニ グローブの空気を満たした指パッドによって満たされるはずです。 充填率は、生成されたオブジェクトの立体感に影響します。 若いデザイナー チームが、仮想現実内での「ナビゲーション」に使用される Virtuix Omni トレッドミルの作成者と協力しています。 デバイスのメカニズムは Arduino プラットフォーム上で動作します。

補充 仮想感覚体験 続けて、「ここでは、東京農工大学の松倉春樹氏率いるチームが、香りを作り出す技術を開発しました。 画面に表示される花や一杯のコーヒーから発せられる香りは、香りのジェルが詰められたカプセルから発生し、蒸発してミニファンによってディスプレイに吹き付けられます。

香りの付いた空気の流れは、香りの付いたオブジェクトが見える画面の部分から香りが「発散」するように変更されます。 このソリューションの現在の制限は、一度に XNUMX つの香りしか放出できないことです。 しかし、日本の設計者によると、間もなくデバイス内のアロマカプセルを交換できるようになるという。

障壁を打ち破る

デザイナーはさらに先へ進みます。 画像認識は、高価で必ずしも完璧ではない光学系や人間の目の不完全性さえも使用する必要性を回避することを大幅に簡素化し、改善します。 こうして「見る」と「見る」の意味の違いを理解するプロジェクトが誕生しました。 現在人気が高まっている仮想現実メガネを使用すると、画像を見ることができます。 一方、クラウドファンディング プラットフォームの Kickstarter だけでなく注目を集めた Glyph と呼ばれる発明により、画像が網膜に直接表示されるため、単純に見ることができるようになります。つまり、私たちが理解しているように、目を部分的に置き換えることになります。 前述の「ニューロマンサー」、つまり神経系による直接的なイメージの認識との関連が必然的に生じます。

9. グリフ - その仕組み

Glyph は単なるゲーム ハードウェア以上のものとして設計されています。 スマートフォンやビデオプレーヤーなどの家電製品との連携が期待されている。 ゲーマー向けには、ヘッド トラッキング メカニズム、内蔵ジャイロスコープ、加速度計、つまり「バイオニック」仮想現実セットが備わっています。 Glyphaを開発したAvegant社によると、目の下に直接投影される画像はより鮮明になるという。 それにもかかわらず、医師、眼科医、神経科医の意見、つまりこの技術についてどう思うかを待つ価値があります。

以前は、特に仮想世界ではなく、たとえば書籍への没入について呼ばれていました。 テキストを 3D 画像に変換する技術の研究が進行中であることが判明しました。

これは、テキストから仮想現実への翻訳者として定義される MUSE (Machine Understanding for Interactive Storytting) プロジェクトがやろうとしていることです。 教授として。 プロジェクトコーディネーターであるルーヴェン在住のマリー・フランシーヌ・モーエンス博士は、そのアイデアは、テキストで指定されているアクション、エンティティ、オブジェクトをビジュアルに変換することであると述べています。 テキストの意味言語を処理するために、改良されたコンポーネントが開発されました。 これには、文内の意味的役割 (つまり、「誰が」、「何をしている」、「どこで」、「いつ」、「どのように」)、物体または人々の間の空間的関係 (それらがどこにあるか)、および出来事の時系列の認識が含まれます。 。

この解決策は子供たちを対象としています。 MUSE は、生徒が読み書きを学びやすくし、推論を発展させ、最終的にはテキストをよりよく理解できるように設計されています。 さらに、暗記とテキスト間の相互接続の確立をサポートすることが期待されます (たとえば、精密科学や生物学に特化したテキストを読む場合)。